最后更新时间:2026-03-07

GPT 5.4 这一轮更新,真正拉开体感差距的不是普通问答,而是需要连续检索、分步推演和跨页面收集证据的科研写作任务。按 OpenAI 发布页披露的数据,它已经把 computer use、深度检索、长上下文和工具搜索压进同一条主线里,重点强化的也是表格建模、文档起草和演示类工作。对做论文的人来说,这意味着它更像一个会自己拆任务的研究助理,而不是只会顺着提示词往下写的聊天框。12

有一点要先说清。按我在 2026 年 3 月 7 日查到的 OpenAI 公开资料,外部可见的模型目录里列出的是 GPT-5、GPT-5.1 和 GPT-5.2,并没有单独列出 GPT 5.4。微信原文里的叫法,更像作者在产品端看到的版本标签或灰度编号。所以下文继续沿用这个名称谈体验,但凡涉及公开规格,我都统一按官方 GPT-5 系列文档理解。123

如果你只是想先把流程跑通,不想先处理海外支付、网络和账号切换,可以直接从下面两个入口试用:

我把原文里最关键的四个科研写作场景重新拆了一遍,并补上了一个更适合中文用户的判断标准:什么时候该把它放进主工作流,什么时候继续用 Gemini 做前置整理更划算。

一、GPT 5.4 这次升级,真正影响科研写作的是什么

很多更新公告喜欢把新版本讲成“全面更强”,但科研写作场景不吃这套。你真正关心的是:面对长任务链时,模型会不会自己补步骤,会不会主动回到可信来源,会不会在输出前先把资料拼齐。它在这三个点上的进步比较明确。

一是 agentic workflow 更完整。原文实测里,选刊和选题都出现了明显更长的思考过程,不再是一轮生成后直接给答案,而是持续检索、比对、筛选,再给出路径。二是 factuality 继续往上提,OpenAI 把它定义成目前更偏事实准确的一代模型。三是 tool search 把工具调用从“全部塞进上下文”改成“按需检索工具”,这会直接减少长任务里的 token 浪费。1

按官方给出的口径,GPT 5.4 的上下文窗口来到 105 万 token,最大输出 12.8 万 token,BrowseComp 从 65.8% 提升到 82.7%。这些数字单独看很技术,但放到论文工作流里就很直观了:长综述草稿、审稿意见、补充实验说明和文献清单可以在同一轮任务里一起处理,模型不用频繁“失忆”。12

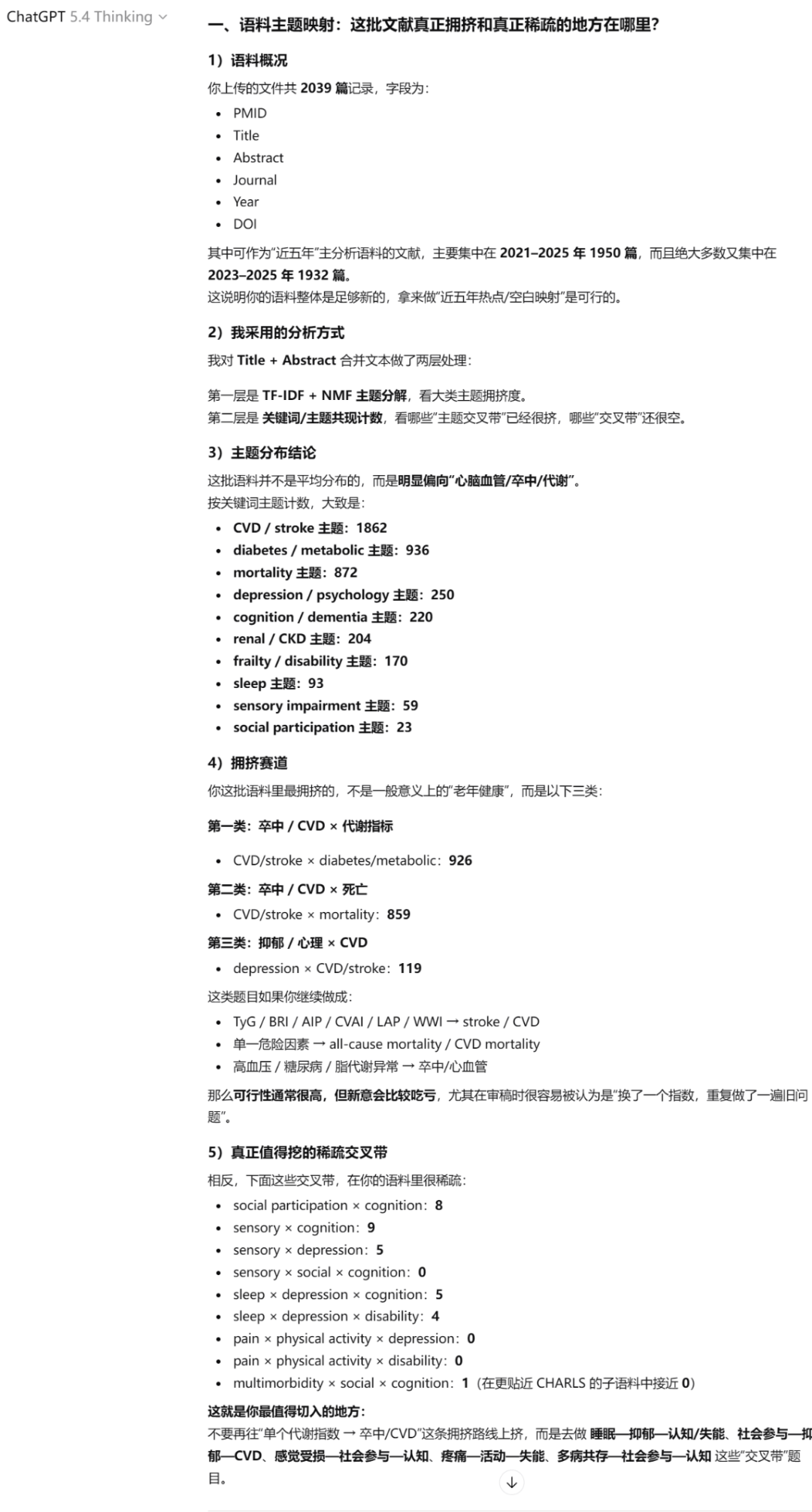

| 维度 | GPT 5.2 体感 | GPT 5.4 体感 | 对科研写作的意义 |

|---|---|---|---|

| 选刊推荐 | 更像一次性回答 | 会持续搜索与收窄范围 | 推荐理由更能对齐摘要与目标期刊 |

| 选题分析 | 结论先行 | 过程更透明 | 便于导师或合作者复核 |

| 论文润色 | 已经够强 | 提升有限 | 单步任务差距不大 |

| 文献补引 | 会补,但不够细 | 逐句找证据 | 更适合综述和 rebuttal |

二、四个科研写作场景里,GPT 5.4 的差异到底在哪里

这篇源文最有价值的地方,不是“它更强”这句结论,而是把 GPT 5.4 放在四个高频任务里看。这样你能看清升级到底发生在任务链的哪一段,而不是被一句“全面进步”带偏。

1)选刊:不是只给名单,而是给出筛选过程

选刊一直是最容易被高估的 AI 场景。很多模型会给你一个看起来像样的期刊清单,但理由很空,来源也混杂,真到投稿环节就不敢用。源文里 GPT 5.4 在这个任务上的变化很明显,思考时间拉长到了 17 分钟左右,输出不再是匆忙拼接的名单,而是逐步缩小范围、补充匹配逻辑,再给出投稿建议。3

更关键的是,它把查询来源尽量压到期刊官网,而不是胡乱混入第三方数据库摘要页。这一点对中文用户很重要,因为很多人在镜像站或聚合站里试模型时,肉眼只看结果,忽略了信息出处。选刊这种高风险任务,只要来源不干净,整份建议的可信度都会被拖垮。

2)选题:更像带你推理,而不是代你拍板

选题分析的提升不在“答案更惊艳”,而在“过程更可复核”。它会把你给的摘要、关键词和文献线索放回分析链条中,让你看到结论是怎么来的。对导师、PI 或课题组负责人来说,这比一句结论更有用,因为他可以直接判断模型是不是忽略了关键变量。

源文里把 5.2 和 GPT 5.4 的差异讲得很准:前者更像给结果,后者更像带着你走一遍拆题过程。这个变化很符合 agentic 模型的方向。模型不是负责替你做学术判断,而是先把问题空间清理出来,再让人做取舍。真正能省时间的,也正是这一步。

3)论文润色:强,但不是这次升级的主舞台

如果你的主要工作只是把一段英文改得更顺,GPT 5.4 不会带来那种“换代感”。源文给出的判断也比较克制,Auto 档大概率调到的是 GPT 5.3 一类的润色能力,和之前版本差距不算大。这个结论反而可信,因为单步改写本来就不是 agentic 能力最容易放大的地方。3

这也解释了一个常见误区:不少用户看到新版本上线,就把所有任务都往新模型上迁。实际更合理的做法,是把 GPT 5.4 留给需要检索、拆解和证据拼装的任务;纯润色、摘要归纳、双语改写这些工作,仍然可以按价格和速度选更轻的模型。

4)文献综述补引:这是最值得升级的一段

四个场景里,我认为文献综述补引最能体现 GPT 5.4 的价值。源文里提到,它会按句子去找支撑文献,而不是对整段话做笼统匹配;补出来的参考文献列表更长、维度更广,时间也更靠近 2023 到 2024 年。对综述写作、回复审稿人和基金申请书,这个差异非常实用。3

问题不在“能不能补参考文献”,而在“补得准不准,敢不敢直接拿去核对”。如果模型只会给一串似是而非的题目,你还得重新搜一遍;如果它能把文献放到具体句子附近,人工核验成本会小很多。对于经常需要做文献清点的人来说,这部分节省的是整块时间。

三、为什么我说 GPT 5.4 更像 agent,而不是更会聊天

看完四个场景,你会发现 GPT 5.4 的变化并不集中在语言表面,而是集中在任务结构。它愿意花更长时间查找依据,愿意把问题拆成多个子动作,再拼回输出。这种行为一旦稳定下来,科研写作的使用方式就会变掉。

以前很多人把模型当成“写作助手”,卡住时问一句,润完一段再问一句。现在更合理的用法是把 GPT 5.4 放到任务的中段,让它接一整包材料:摘要、目标期刊、已有引文、导师意见、投稿限制。它不一定一次给出完美答案,但能把原本分散在浏览器、数据库和笔记里的步骤并到一起。

对站内用户而言,这也是为什么我不建议把所有需求都压在一个入口里。若你平时已经习惯用 gemini官网 替代入口做资料预读,再用 gemini镜像站 做多模态问答,那么把 GPT 5.4 接在后面做深度检索和成稿推演,通常比“从头到尾只用一个模型”更顺。对于只想快速试错的人,gemini中文版 和 gemini 国内使用 场景下的网页入口,依然适合先做问题拆解,再把复杂检索任务切给 GPT 5.4。

四、把 GPT 5.4 放进中文工作流,我建议这样搭配 Gemini

真正落地时,不必把 GPT 5.4 和 Gemini 做成二选一。中文团队更常见的高效路线是分层使用。前置层用 Gemini 处理多模态输入、网页材料预读、截图理解和中文提纲粗整理,中段交给 GPT 5.4 做证据搜索、选刊判断、逐句补引和复杂写作规划,收尾层再回到轻量模型做格式修订和定稿检查。

这种搭配的好处有两个。一个是成本更稳。你不会把重模型浪费在简单任务上。另一个是决策更清楚。你可以明确规定:凡是涉及引用、投稿方向、论证结构的任务走 GPT 5.4;凡是涉及图文混合阅读、资料归并和中文改写的任务,优先走站内可直接访问的网页入口。像 AIMirror Gemini 中文站 这类聚合入口,本身就支持 GPT-5、Gemini、Claude 和 Grok,拿来做对比测试比单独切站更省事。

五、两套能直接复制的 GPT 5.4 提示词

如果你要判断 GPT 5.4 值不值得升级,不要只问“你觉得这篇文章投哪里”。更好的方法,是直接让它处理你真实会遇到的约束。下面两套提示词都偏重过程透明和证据输出,比较能放大 GPT 5.4 的优势。

角色:你是科研选刊助手。

任务:基于我提供的摘要、关键词、方法学和目标影响因子区间,筛出 5 本候选期刊。

要求:

1. 每本期刊都给出匹配理由、审稿周期、开放获取情况和官网链接。

2. 只优先引用期刊官网、出版社官网或官方 author guidelines。

3. 若信息不足,先列出还缺哪些变量,再继续搜索。

输出格式:

- 候选期刊表

- 不建议投稿的理由

- 一周内可执行的投稿准备清单

角色:你是文献综述共同作者。

任务:阅读我的综述草稿后,按句子补充近三年的核心参考文献。

要求:

1. 每一句最多补 2 到 3 篇最相关文献。

2. 明确标注每篇文献支撑的是哪一句话,不要整段笼统匹配。

3. 如果发现某句话证据不足,直接指出并建议改写方向。

输出格式:

- 原句

- 建议补引文献

- 文献支持点

- 需要人工复核的风险

这两套提示词的核心不是“写得像人”,而是逼模型把依据摊开。GPT 5.4 真正强的部分,是能不能把检索路径、判断条件和缺失变量暴露出来。只要这三项做到了,你后续不管是用官网吗,还是继续在镜像入口里协作,返工都会少很多。

六、哪些人该升级,哪些人可以先观望

如果你的工作以选刊、选题、综述补引、rebuttal 和基金书写作为主,GPT 5.4 值得尽快上手,因为它解决的是长任务链里的时间浪费。如果你平时主要拿模型做润色、摘要改写、邮件回复和轻量问答,那么先观望也没问题,这一轮升级不会把这些任务的结果拉开到不可替代。

我更看重的一点,是这次更新把“过程透明”往前推了一步。中文用户在使用大模型时,经常不是怕模型写得不顺,而是怕它给出一个看似完整、实则无法核验的答案。只要模型能把路径、来源和不确定性说清楚,它就更适合进入真实科研流程。

如果你想自己测一轮,建议用同一份摘要、同一组关键词、同一份综述草稿,分别在 AIMirror Gemini 中文站、chat.write360.cn 和官方 API 环境里做横向对比,重点看三件事:来源是否可追、推理过程是否稳定、补引结果是否经得起人工抽查。把这三个问题跑清楚,你对 GPT 5.4 的判断基本就不会偏。

1 Introducing GPT-5.2(访问日期:2026-03-07)